Warum eigentlich?

Ich bin überzeugt, dass KI-Tools im NGO-Bereich dabei helfen können, Flaschenhälse zu weiten oder zu zerschlagen. Zu viel hält uns davon ab, uns für die Dinge zu engagieren, die uns wirklich wichtig sind: Buchhaltung, Übersetzung, Dokumentation oder das unendliche Feilen an Social-Media-Posts und Newslettern gehören meist nicht zu unseren Kernzielen. KI kann helfen, diese Arbeit zu automatisieren und damit mehr Raum für soziales Miteinander oder politische Aktion zu schaffen.

UND: Ich glaube, dass wir dabei vorsichtig sein müssen:

> Damit wir den eigenen Leistungsdruck nicht ins Unermessliche steigern,

> Vertrauen in der Zusammenarbeit und Kommunikation verlieren,

> schlechte Entscheidungen und Bias der Vergangenheit wiederholen,

> unsere Daten in die falschen Hände geraten oder

> wir unsere Ziele für Klimaschutz dadurch ad absurdum führen extrem ressourcenintensive Technologie einzusetzen.

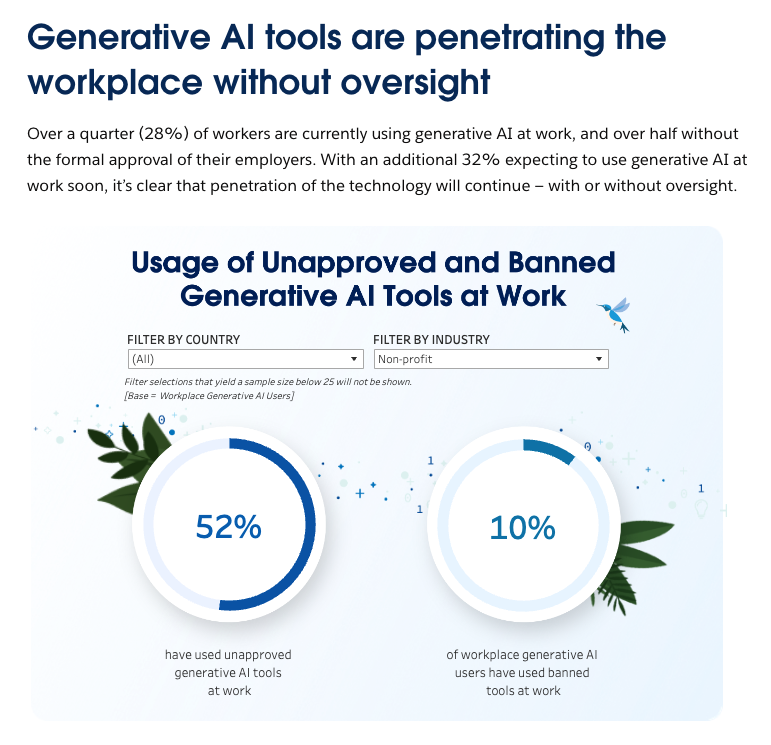

Eine Studie aus November 2023 zeigt, dass KI in NGOs längst Realität ist. 52% der Mitarbeiter*innen gaben an, Tools zu benutzen, die nicht offiziell genehmigt wurden. 10% im Non-Profit- Bereich geben an, Tools zu verwenden, die offiziell von der Organisation verboten sind. (In D über alle Sektoren sind es sogar 34%.)

Lasst uns deshalb nicht mehr über das Ob diskutieren, sondern Wie wir ethisch begründet KI im NGO-Alltag einsetzen können. Hier mein Versuch Mindeststandards zu formulieren. Ich hoffe, dass sie nach Debatte und im Kontakt mit euch im Laufe von 2024 zu einem Code of Good Practice – eine Art Selbstverpflichtung für NGOs – werden. Ich freue mich auf jede Kritik und Diskussion!

KI-Kompass

(Stand Dezember 2023)

- Einsatz mit Abwägung

- Gemeinsam im Team

- Transparenz

- Auseinandersetzung mit Bias und Vergangenheitsorientierung

- Hoher Datenschutz

- Mit dem Willen zu lernen

Falls ihr konkrete Leitlinien sucht. Die gibt es inzwischen auch als Vorlage:

> Leitlinien für die Nutzung von KI in Vereinen

Grundsatz 1: Einsatz mit Abwägung

Wir setzen KI nur dort ein, wo

*es uns hilft, unsere Ziele zu erreichen,

*es keine ressourcenärmeren Wege gibt,

*der voraussichtliche Nutzen die bekannten Risiken überwiegt.

UND:

Der Einsatz muss rückholbar sein.

Grundsatz 2: Gemeinsam im Team

Wir machen im Team, auch zwischen Haupt- und Ehrenamt, transparent, wer wozu KI einsetzt. Niemand wird zum Einsatz gedrängt.

Wir nutzen KI, um unsere Arbeit zu erleichtern.

Wir gehen selbstkritisch mit den damit oft verbundenen erhöhten Leistungserwartungen einher.

Wir beobachten und reflektieren aktiv, ob und wie KI unsere Zusammenarbeit im Team verändert. Soziale Beziehungen bleiben wichtiger als Effizienz.

Wir nutzen KI nicht zur Leistungsbewertung.

Grundsatz 3: Transparenz

Wir sind gegenüber Ehrenamtlichen, Zielgruppen und Adressat*innen proaktiv transparent, wo und wie wir KI einsetzen. Dies gilt besonders für personalisierte Verfahren.

Wir nutzen KI nicht, um menschliches Verhalten heimlich zu imitieren, DeepFakes ohne Kennzeichnung zu erstellen oder andere Formen von Miss-Information zu unterstützen.

Grundsatz 4: In andauernder Auseinandersetzung mit Bias und Vergangenheitsorientierung

Wir machen uns immer wieder bewusst, dass KI-Modelle von ihren Daten und Trainings abhängig sind und viele, auch nicht offensichtliche, Bias reproduzieren. KI-Modelle sind vorwiegend mit englischen Daten und fast ausschließlich mit Daten aus dem globalen Norden trainiert. Sie reproduzieren somit dessen Sichtweisen der Vergangenheit.

Wir lassen KI keine Entscheidungen treffen und kontrollieren Vorschläge aktiv, bevor wir ihnen folgen.

Grundsatz 5: Mit hohem Datenschutz

Wir nutzen personenbezogenen Daten nur in Tools und Settings, bei denen wir und die Betroffenen Speicherung und Nutzung der Daten nachvollziehen können.

In den allermeisten Tools ist das zum aktuellen Zeitpunkt nicht gegeben.

Wir sind vorsichtig beim Teilen von anonymisierten Daten und überlegen im Vorfeld, ob eine KI in der Lage sein wird, sie zu de-anonymisieren.

Grundsatz 6: Mit dem Willen zu Lernen

KI und Large Language Modelle stecken noch in den Kinderschuhen. Und sie sind keine Magie, sondern ihre Benutzung Handwerk. Deshalb nehmen wir uns Raum zum Ausprobieren, lernen offen miteinander und teilen Erfolge und Misserfolge.

Wir sind uns bewusst, dass der Einsatz von KI auch unsere Organisationsprozesse und unsere Art der Arbeit verändern kann und gehen entsprechende Organisationsentwicklungen bewusst an.

Und noch konkreter:

Würde euch ein Leitlinien-Entwurf als Vorlage nutzen?

Zusammen mit dem Pari Gesamtverband habe ich eine Vorlage für NGOs entwickelt. Sie ist unter CC0-Lizenz erschienen, d.h. zur komplett freien Verfügung für euch. Und ich aktualisiere sie auch immer mal, wenn ich gutes Feedback erhalte.